طبق آمار و ارقام، بیش از 87 درصد از کاربران اینترنت برای جستجو در سطح وب از گوگل استفاده میکنند. گوگل محبوبترین موتور جستجو است و اغلب عملکرد آن بر مبنای الگوریتمهای آن است. در حوزه سئو بیشترین چیزی که اهمیت دارد، این است که چگونه بتوانیم خود را با الگوریتمهای گوگل تطبیق دهیم.

نحوه انجام سئو و همچنین معیارهای آن نسبت به 10 سال پیش به طور کلی تغییر کرده است. دلیل مهم آن هم این است که الگوریتمهای رتبهبندی گوگل، به طور مداوم تغییر میکنند تا بتوانند بهترین و مرتبط ترین نتایج را به کاربران نمایش دهند. در 10 سال گذشته، گوگل به عنوان موتور جستجوی پیشرو، چندین آپدیت مهم را در هسته های مرکزی الگوریتم های خود معرفی کرده که هر یک از آنها تاثیر زیادی بر شیوههای سئو داشتهاند.

من، حسام الدین کیانی خواه ، قصد دارم شما را با انواع الگوریتم های گوگل بیشتر آشنا کنم. در این مقاله تاریخچهای از گوگل و الگوریتمهای آن از سال 2011 تا 2022 برایتان آماده کرده ام. اگر علاقه دارید که درباره این موضوع بیشتر بدانید با من همراه باشید.

الگوریتم به چه معنی است؟

قبل از اینکه به سراغ لیست الگوریتم های گوگل برویم، بیایید ابتدا نگاهی به تعریف الگوریتم بیندازیم. تعریف استاندارد الگوریتم این است:

مجموعه ای از قوانین برای حل یک مسئله در تعداد محدودی از مراحل

در زبان کامپیوترها، یک الگوریتم زمینه را برای کامپیوتر برای انجام یک کار بسیار خاص فراهم می کند. برای مثال، کامپیوتر ممکن است طوری برنامه ریزی شود که به طور تصادفی عددی بین 1 تا 100 به دست آورد. راه دیگر نگاه کردن به الگوریتم این است که آن را به عنوان یک معادله ریاضی در نظر بگیریم. ممکن است از شما خواسته شود که با 4 اختلاف از 100 تا 80 برعکس بشمارید. سپس میگویید: “100، 96، 92، 88، 84، 80.” روی کاغذ، ممکن است انتظار داشته باشید که در یک ستون نشان دهید که چگونه با تفریق عدد 4 به هر پاسخی دست یافته اید. اگرچه این یک نگاه ساده به یک الگوریتم است، اما به درک نسخه های پیچیده تر کمک می کند.

الگوریتم گوگل به چه معناست؟

الگوریتم های گوگل یا الگوریتم های سئو مجموعه قوانینی هستند که گوگل از آنها برای رتبه بندی وب سایت ها در نتایج جستجو استفاده می کند. سیستم پیچیده گوگل، داده ها را از صفحات سایت بازیابی می کند و به دنبال درک آنچه کاربران به دنبال آن هستند و رتبه بندی صفحات بر اساس ارتباط و کیفیت است.

الگوریتم های گوگل از همان تعریف اولیه و قانون الگوریتمی پیروی می کنند که توضیح دادم.

به آخرین باری که چیزی را در گوگل جستجو کردید فکر کنید. چه «آموزش سئو» یا «آموزش فتوشاپ» را تایپ کرده باشید، موتور جستجو میلیونها نتیجه را در اختیار شما قرار می دهد.

اما گوگل چگونه تصمیم گرفت کدام نتایج را به شما نشان دهد و به چه ترتیبی؟ یک الگوریتم

گوگل الگوریتم های بسیار پیچیده ای برای ارائه نتایج جستجو دارد و تغییرات و به روز رسانی های نسبتاً زیادی دارد. گوگل همچنین از فاکتورهای مختلفی برای رتبه بندی سایت ها در نتایج استفاده می کند که من در مقاله لیست فاکتورهای گوگل توضیح داده ام. اگرچه این شرکت الگوریتم اصلی و فاکتورهای آنرا عمومی نمی کند اما چند عامل اصلی وجود دارد که می دانیم بر توانایی یک سایت برای نمایش در نتایج برای کلمات کلیدی خاص تأثیر دارند:

- وجود کلمه کلیدی در عنوان صفحه، متاتایتل و توضیحات متا

- تعداد لینک های داخلی و خارجی طبیعی و ارگانیک به هر صفحه

- نحوه عملکرد وب سایت در دستگاه های تلفن همراه، مانند تلفن های هوشمند و تبلت ها

البته، اینها تنها برخی از مهم ترین ویژگی هایی است که الگوریتم های گوگل هنگام تعیین نحوه رتبه بندی صفحات بررسی می کند. احتمالاً هزاران فاکتور در طی رتبه بندی بررسی می شوند.

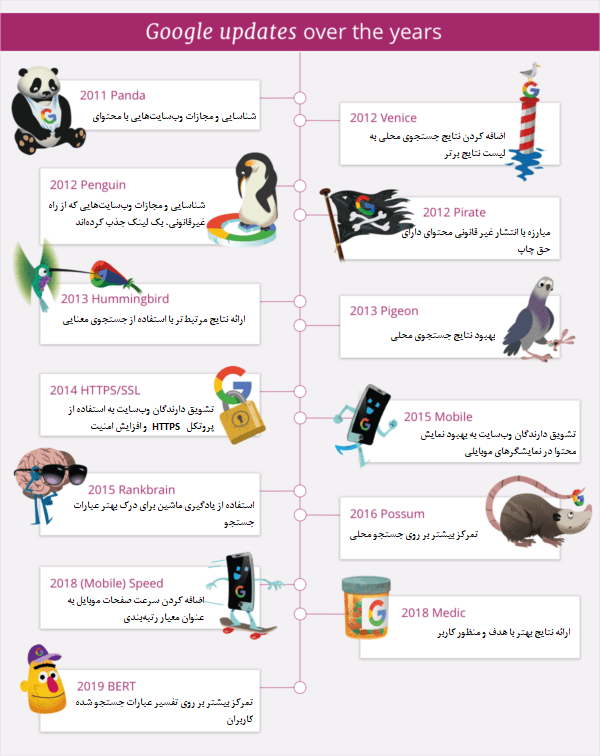

همانطور که تا الان ذکر شد، کار رتبه بندی صفحات نه فقط توسط یک الگوریتم بلکه چندین الگوریتم مختلف را درگیر می کند. بنابراین من در این قسمت می خواهم مهم ترین الگوریتم های گوگل را از زمان ظهور اولین آنها تا جدیدترین الگوریتم ها در سال 2022 بررسی کنم :

مهم ترین الگوریتم های گوگل ( از سال 2011 تا 2022 )

- الگوریتم کافئین – 2010

- الگوریتم پاندا – 2011

- الگوریتم ونیز – 2012

- الگوریتم پنگوئن – 2012

- الگوریتم دزدان دریایی – 2012

- الگوریتم مرغ مگس خوار – 2013

- الگوریتم کبوتر – 2014

- الگوریتم HTTPS – سال 2015

- الگوریتم موبایل گدون -2015

- الگوریتم رنک برین – 2015

- الگوریتم موش کور – 2016

- الگوریتم سرعت – 2018

- الگوریتم مدیک – 2018

- الگوریتم برت – 2019

- الگوریتم تجربه کاربری – 2021

- الگوریتم MUM

الگوریتم کافئین (Caffeine) – 2010

«گوگل کافئین» (Google Caffeine) یکی از بهروزرسانیهای بزرگ گوگل بود که در سال 2010 راهاندازی شد. این الگوریتم که برای بهبود سرعت و دقت نتایج جستجوی گوگل توسعه یافت، یک سیستم ایندکس و کراول صفحات با سرعت بسیار بالا محسوب میشود. الگوریتم کافئین طراحی شد تا رباتهای گوگل بتوانند صفحات وب را سریعتر و کارآمدتر بخزند و سپس رتبهبندی کنند.

یکی از ویژگیهای اصلی Google Caffeine توانایی آن در پردازش اطلاعات در لحظه است. به کمک این الگوریتم، محتوای جدید یا آپدیتشده میتواند تقریباً بلافاصله در نتایج جستجو نمایش داده شود و تجربه جستجوی مخاطب را سریعتر و مرتبطتر کند.

البته این الگوریتم روی ایندکس تصاویر و ویدیوها نیز تاثیراتی داشت. گوگل از کافئین استفاده کرد تا پشتیبانی بهتری از فرمتهای ویدئویی و تصویری داشته باشد و با توجه به کلمات کلیدی و هدف کاربر، گزینههای مرتبطتری پیشنهاد دهد. به طور خلاصه، هدف از توسعه و پیادهسازی الگوریتم کافئین گوگل، بهبود سرعت و دقت نتایج جستجو بوده است.

این الگوریتم برای رسیدن به هدفش، روی سیگنالهای خاصی مثل جدید بودن محتوا، طرحبندی و ساختار صفحات و همچنین کیفیت محتوا توجه میکند. یکی از قابل توجهترین تغییراتی که کافئین با خودش داشت، نمایش نتایج لحظهای از شبکههای اجتماعی مثل توییتر و فیسبوک بود.

یعنی بعد از این الگوریتم، اگر کلمات کلیدی موردنظر مخاطب در شبکههای اجتماعی یافت شود، به احتمال زیاد در نتایج جستجوی گوگل نیز ظاهر خواهند شد.

الگوریتم پاندا (Panda) – 2011

گوگل در سال 1998 به عنوان یک موتور جستجو شروع به کار کرد. اما الگوریتم پاندا در سال 2011 معرفی شد. در واقع با اینکه گوگل تا قبل از سال 2011 فعالیت میکرد، اما الگوریتم پاندا اولین آپدیت بزرگ این موتور جستجو بود. با معرفی الگوریتم پاندا، گوگل نظارت خود را در سطح وب توسعه داد و سعی کرد با وبسایتهایی که فقط رتبه گرفتن در گوگل فعالیت می کنند و محتوای باارزشی ایجاد نمی کنند، برخورد کند.

در واقع الگوریتم پاند بر محتوا یا Content صفحه تمرکز داشت. این الگوریتم با محاسبات خود مشخص میکرد که وبسایت X واقعاً اطلاعاتی درباره عبارت جستجو شده (که به آن کوئری Query میگوییم) ارائه میدهد یا خیر. با اجرای این الگوریتم دو دسته از وبسایتها تحت تاثیر قرار گرفتند.

- دسته اول وبسایتهایی بودند که کلمات کلیدی را در محتوای ضعیف (thin content) جایگذاری میکردند

- دسته دوم نیز وبسایتهای وابسته به سایت اصلی، که وظیفه آنها لینک دادن و معرفی صفحات خاص سایت اصلی بود.

گوگل به طور دوره ای الگوریتم گوگل پاندا را پس از اولین انتشار، آپدیت کرد. گوگل در سال 2016، پاندا را در هسته مرکزی خود گنجاند. آپدیت الگوریتم پاندا تنها به دنبال محتوای قوی و باارزش بود. این بهروزرسانی همچنین اعلام کرد که صاحبان وبسایت، نمیتوانند با تولید محتوای نامناسب در گوگل رتبه بگیرند.

الگوریتم ونیز (Venice) – 2012

الگوریتم بعدی در الگوریتمهای گوگل، ونیز است. این الگوریتم به طور قابل توجهی نمایش نتایج محلی یا لوکال (Local) را افزایش داد. پایه و اساس این الگوریتم این است که گوگل فهمید، کاربران گاهی اوقات به دنبال نتایجی هستند که در نزدیکی آنها است. پس از معرفی این الگوریتم، نتایج جستجو شامل صفحاتی بر اساس مکان یا آدرس IP کاربر شد.

الگوریتم پنگوئن (Penguin) – 2012

گوگل با معرفی الگوریتم پنگوئن به موضوع بکلینک و لینک دهی پرداختند. این بهروزرسانی لینکهایی که از دیگر وبسایتها دریافت میکنید را بررسی میکند. این بررسی شامل کیفیت بکلینکها و میزان مرتبط بودن آنها میشود اما تمرکز اصلی الگوریتم پنگوئن این است که کنترل کند آیا بکلینکهای یک سایت واقعی هستند یا اینکه برای دور زدن موتورهای جستجو خریداری شدهاند. این آپدیت تلاش کرد از خرید، مبادله یا ساخت لینک های مصنوعی جلوگیری کند.

اگر بکلینک به عنوان لینک مصنوعی یا ساختگی شناسایی شود، گوگل به جای ارزش لینک مثبتی که قبلا دریافت کرده بود، یک ارزش منفی به سایت مربوطه اختصاص میداد. پس از انتشار، آپدیت پنگوئن چندین بار اجرا و تست شد و گوگل آن را در سال 2016 به هسته مرکزی خود اضافه کرد.

در واقع انتشار الگوریتم پنگوئن نشان داد که برای دریافت لینک، باید استراتژی درستی را توسعه دهید و نمیتوان این کار را با پرداخت هزینه انجام داد.

الگوریتم دزدان دریایی (Pirate) – 2012

با معرفی این الگوریتم، گوگل شروع به مبارزه با انتشار غیرقانونی محتوای دارای حق چاپ (مانند کتاب) کرد. درخواستهایی که بر اساس قانون DMCA برای گوگل ارسال میشد، به عنوان عامل رتبهبندی منفی وبسایتها در نظر گرفته میشدند.

DCMA به معنی قانون کپی رایت هزاره سوم و مخفف عبارت the Digital Millennium Copyright Act است.

الگوریتم مرغ مگس خوار (Hummingbird) – 2013

الگوریتمی که در سال 2013 معرفی شد، به الگوریتم مرغ مگسخوار یا Hummingbird معروف است. گفته می شود آینده سئو به این الگوریتم وابسته است.

با الگوریتم مرغ مگسخوار، گوگل، سطح دانش هسته مرکزی خود را افزایش داد و جستجوی معنایی را به آن اضافه کرد. در واقع این الگوریتم برای اینکه نتایج جستجو، ارتباط بیشتری با کلمه کلیدی جستجو شده داشته باشند، به هر کلمه در یک عبارت جستجو توجه میکند و اطمینان می یابد که کل عبارت جستجو شده به عنوان یک واحد کامل و نه کلمات خاص در نظر گرفته میشود.

همچنین بهروزرسانی مرغ مگس خوار باعث شد که گوگل زمینه را برای جستجوی صوتی فراهم کند. موردی که حالا در سال 2022 اهمیت بیشتری پیدا کرده است.

این الگوریتم در واقع بر استفاده از موضوع NLP یا درک زبان تاکید میکرد و برای نمایش نتایج، به کلمات مهم موجود در عبارت جستجو شده اکتفا نمیکرد.

بر خلاف دیگر الگوریتمهای گوگل، این الگوریتم قصد اعمال مجازات به صورت مستقیم را نداشت. اما بر مسائلی مانند خوانا بودن محتوا و ترجمه و تولید محتوا به زبان طبیعی و کاربردی و نه صرفا ماشین تاکید میکرد. در ضمن مرغ مگسخوار تاکید میکند که محتوا نباید برای کلمات کلیدی خاص بهینه شود و باید از کلمات مرتبط و یا با معنی مترادف و یکسان نیز در محتوا استفاده شود.

مشاوره رایگان سئو

الگوریتم کبوتر (Pigeon) – 2014

یکی دیگر از الگوریتمهای گوگل که سئو محلی را هدف قرار داد، الگوریتم کبوتر بود. آلگوریتم کبوتر هم بر نتایج و هم بر نقشه گوگل تاثیر گذاشت. در واقع هدف این بود که تعیین مکان کاربر با دقت بیشتری انجام شود تا نیاز کاربر از نزدیکترین مکان ممکن رفع گردد.

این الگوریتم همچنین باعث شد که نتایج ارائه شده تحت عنوان جستجوی محلی، مرتبطتر باشند. به عنوان مثال هدف این بود که اگر در جستجوی کافه یا رستوران هستید، بهترین و نزدیکترین رستوران برای شما نمایش داده شود.

معرفی HTTPS/SSL در سال 2015

گوگل با معرفی HTTPS/SSL بیشتر به مسئله امنیت پرداخت. در واقع وبسایتهایی که پروتکل HTTPS را پیادهسازی کنند، به دلیل اهمیت دادن به امنیت، از سوی گوگل یک امتیاز مثبت دریافت میکردند. در آن زمان بود که HTTPS به عنوان یک سیگنال رتبهبندی اما نه چندان مهم و تاثیرگذار معرفی شد.

الگوریتم موبایل گدون (Mobilegeddon) – 2015

در سال 2015 الگوریتم موبایل گدون به دلیل استفاده روزافزون کاربران از موبایل ارائه شد. در این سال بیش از 50 درصد جستجوهای گوگل از طریق تلفن همراه انجام میشد که همین باعث ارائه این بهروزرسانی شد. با این الگوریتم، به وبسایتهایی که محتوا را به شکلی مناسب برای موبایل نمایش میدادند یا اصطلاحا ریسپانسیو بودند، امتیاز رتبهبندی تعلق گرفت.

گدون (geddon) از واژه یونانی آرماگدون گرفته شده و به معنی نبرد بزرگ است. این نامگذاری به این دلیل است که افراد فعال در سئو گمان میکردند این الگوریتم نتایج جستجو را کاملا تغییر خواهد داد. ارائه این الگوریتم باعث ایجاد تغییرات گسترده در نتایج موتورهای جستجو نشد اما با این وجود از اهمیت روزافزون موبایل خبر داد.

الگوریتم رنک برین (RankBrain) – 2015

یکی دیگر از الگوریتمهای گوگل در سال 2015، رنک برین (RankBrain) بود. در این الگوریتم از یادگیری ماشینی برای نمایش بهترین و مرتبط ترین نتیجه به کاربر استفاده شده است. در واقع RankBrain میتواند معنی کلماتی که نمیداند را حدس بزند، کلماتی با معانی مشابه پیدا کند و سپس نتایج مرتبط را ارائه دهد.

با معرفی این الگوریتم جدید، گوگل یک قدم دیگر به کامل کردن جستجوی معنایی نزدیک شد.

نکتهای که درباره این الگوریتم وجود دارد این است که نمیتوانید با روشهای سنتی، وبسایت خود را برای این الگوریتم بهینه کنید. تنها راهی که وجود دارد این است که سطح محتوای خود را بهبود بخشید و محتوای با کیفیت تولید کنید. در ضمن در مارس سال 2016، گوگل فاش کرد که الگوریتم RankBrain یکی از سه سیگنال مهم رتبه بندی است.

الگوریتم موش کور (Possum) – 2016

گوگل در سال 2016 بار دیگر جستجوی محلی را هدف قرار داد. با الگوریتم پوزوم یا موش کور، تغییراتی در شیوه رتبهبندی اعمال شد تا جستجوی محلی به شیوهای بهتر ارائه شود. پس از Possum، نتایج محلی متنوعتر شدند که بیشتر به موقعیت فیزیکی جستجوگر و عبارت مورد جستجو بستگی داشت.

برخی از کسبوکارها که در جستجوی ارگانیک به خوبی عمل نمیکردند، پس از این آپدیت در نتایج محلی نمایش داده شدند. این نشان می دهد که این بهروزرسانی جستجوی محلی را مستقل تر از نتایج ارگانیک دنبال می کند.

الگوریتم سرعت (Speed) – 2018

با این بهروزرسانی، گوگل سرعت بارگذاری یا لودینگ صفحه را به عنوان یک فاکتور مهم برای جستجو در موبایل درنظر گرفت. نکته دیگر این است که معیار سرعت، از قبل برای نمایش محتوا در دستگاههای دسکتاپی (مثل کامپیوتر یا لپ تاپ) وجود داشت، این بهروزرسانی بیشتر وبسایتهایی را تحت تاثیر قرار داد که برای موبایل بهینه نشده بودند.

الگوریتم مدیک (Medic) – 2018

این الگوریتم به این دلیل با این عنوان (Medic) شناخته شد که بیشتر بر روی وبسایتهای پزشکی تاثیرگذار بود. در حالی که تعداد زیادی از وبسایتهای پزشکی از لحاظ سئو آسیب دیدند، اما هدف فقط سایتهای پزشکی نبود.

با اینکه هدف دقیق این الگوریتم مشخص نیست اما ظاهرا تطبیق بهتر نتایج با هدف کاربران و محافظت از کاربران در برابر اطلاعات نامعتبر از اهداف این الگوریتم بودند.

الگوریتم برت (BERT) – 2019

الگوریتمی که در سال 2019 از سوی گوگل منتشر شد، برت (BERT) نام دارد. بهروزرسانی BERT گوگل به عنوان بزرگترین آپدیت در پنج سال گذشته اعلام شد. این الگوریتم، یک مورد از هر ده جستجو را تحت تاثیر قرار داد.

قبل از هر چیزی BERT به معنی Bidirectional Encoder Representations from Transformers میباشد. با اینکه معنی آن شاید چندان واضح نباشد، به نمایش رمزگذاری دوطرفه از سوی انتقال دهندهها معروف است. در واقع این الگوریتم بر پایه یادگیری ماشین، یک تکنیک مبتنی بر شبکههای عصبی برای پردازش زبان طبیعی یا NLP است.

به صورت ساده الگوریتم برت، می تواند با نگاه کردن به کلمات قبل و بعد، معنی کامل یک کلمه را دریابد و تفسیر آن خطی نیست. این الگوریتم پیشرفت بزرگی در تفسیر یک عبارت جستجو و هدف و نیت پشت آن است.

آپدیت تجربه کاربری (page Experience) – 2021

همانطور که قبلتر اشاره کردیم، معرفی الگوریتمهای جدید گوگل تا Page Experience رسیده است. با این الگوریتم، گوگل سیگنال رتبهبندی جدیدی را معرفی کرد که شامل معیارهایی مانند شیوه تعامل کاربر با بارگذاری صفحه است.

Page Experience سیگنال رتبه بندی جدیدی نیست. در این بهروزرسانی، دادههای این الگوریتم با Core Web Vitals ترکیب میشوند تا دادههایی با دقت بالا از تجربه کاربری استخراج شوند. به طور کلی، بهروزرسانی Page Experience به این معنی است که گوگل به دنبال نگاه جامعتر و عمیق تری از تجربه کاربر در صفحه است.

الگوریتم بعدی گوگل : MUM

لیست الگوریتمهای گوگل با معرفی الگوریتم MUM به پایان خواهد رسید. MUM مخفف عبارت Multitask United Model است و در واقع به معنی مدلی واحد است که میتواند چندین وظیفه را انجام دهد. این الگوریتم میتواند بیش از 75 زبان دنیا را در انواع مختلف محتوا (متن، صدا و ویدیو) بخواند، بفهمد و یاد بگیرد. ایده اصلی این است که MUM منابع زیادی را برای ارائه پاسخهای چندلایه به جستجوهای پیچیده به کار میگیرد اما در حال حاضر این الگوریتم ارائه نشده است.

کلام آخر

همانطور که خواندید الگوریتمهای گوگل در طول این سالها بسیار پیشرفت کردهاند. اوایل تمرکز گوگل بر روی وبسایتهای اسپم بود. با گذشت زمان گوگل بر روی ارائه نتایج مرتبطتر و باکیفیت تر برای هر جستجو تمرکز کرد. اما هدف الگوریتمهای جدید گوگل، جستجوی معنایی و سازماندهی و نمایش اطلاعات به شکلی بهینهتر و مناسبتر است.

اگر تازه با وب سایت من آشنا شدید، می توانید سایر مقالات آموزشی سئو را دنبال کنید.

سوالات متداول :

الگوریتم های گوگل کدام اند؟

گوگل الگوریتم های مختلفی برای پایش و فیلتر فضای وب از محتوای بی کیفیت دارد. این الگوریتم ها عبارتند از پاندا، پنگوئن، مرغ مگس خوار، دزدان دریایی و …

جدیدترین الگوریتم گوگل کدام است؟

جدیدترین الگوریتم گوگل در سال 2021 به نام MUM معرفی شده ولی همچنان به طور کامل پیاده سازی نشده است.

سلام جناب کیانی

الگوریتم های گوگل در سئو همون مطلبی بود که دنبالش بودم ولی ای کاش به الگوریتم های 2022 و 2023 هم اشاره میکردین

24

سلام وقت بخیر

ممنون از پیشنهادی که داشتین، محتوا حتما با آپدیت های 2023 گوگل هم آپدیت میشه

28